最近几天,整个PC行业都沉浸在CES展的气氛中,无论是厂商、媒体,还是大多数消费者,都在关注、讨论着各式各样的新技术和新产品。

对于我们三易生活来说,当然也不例外。前几天,我们刚刚为大家带来了RTX 4070 Ti的首发评测。但在今天,我们想来聊聊NVIDIA在此次CES期间发布的另外一个“小玩意”,以及它背后可能并不太让人开心的那些事。

这个东西的名字,叫做RTX视频超分辨率技术(RTX Video Super Resolution)。根据NVIDIA方面的说法,这是一种基于显卡内置AI算力来实现的在线视频画质实时增强功能。

它的作用包括但不限于:

将低分辨率的视频实时上转换为高分辨率(比如将1080P实时处理为4K)

自动增强视频的锐度,使其看起来细节更加丰富

自动删除因为不高的压缩质量,而出现的色块和伪影

如果平时有关注过高端电视,你可能已经发现,与如今绝大多数电视里采用的AI图像增强(也叫AIPQ)技术相比,NVIDIA这套“RTX视频超分辨率”看起来并不先进,甚至在功能上可以称之为简陋。因为它似乎并不支持基于场景自动检测的视频色彩优化(也就是自动让天更蓝、草更绿),也不支持基于图像语义分割的视频主体突出处理(让画面中的前景物体和背景物体分别呈现出不同的清晰度,从而更加突出主体)。

说实在的,这合理吗?很不合理,但不得不承认,它确实也有一些合理之处。

说不合理,是因为按照NVIDIA方面目前公布的相关信息显示,“RTX视频超分辨率”只会兼容从RTX20系到RTX40系的显卡。这也就意味着,它在实时处理视频画面时,本质上很可能是要调用显卡的Tensor Core张量单元,甚至可能要用到部分RT Core光追单元的处理能力。因此不具备这两个单元的“非RTX”系列显卡,自然也就无法兼容这项功能了。

然而大家要知道,哪怕是与最低端的RTX显卡(比如RTX2050)相比,如今智能电视SoC里集成的AI单元算力都要差上很多。于是这也就意味着,NVIDIA的工程师守着相当于电视SoC少则数倍、多则数百倍的AI算力硬件,却做出来了可能复杂程度连如今入门级4K电视AIPQ功能都不如的一个“视频增强”算法。

而且电视上的AI画面处理技术,起码也是在至少三、四年前就已经存在,NVIDIA这几乎就属于是“抄作业”都没抄全。虽然看似给用户提供了一个免费福利,但对于真正有需求的人来说,却未必能够让他们满意。

但是从另一个角度来说,NVIDIA将显卡的这个“RTX视频超分辨率”功能做成如今这幅样子,却也可能还存在着一些现实的、合理的理由。

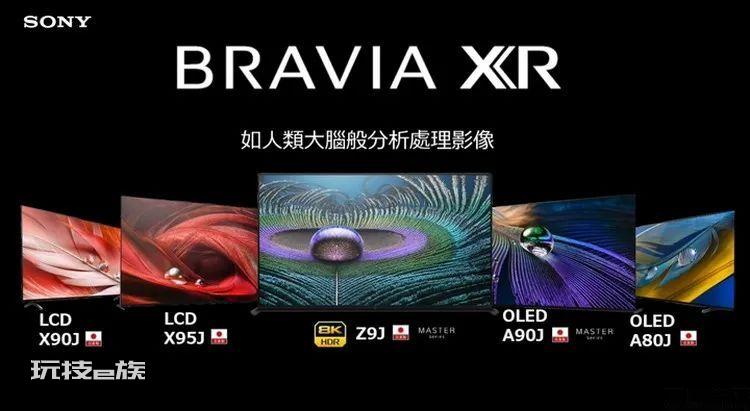

索尼是最早基于“影视数据库”实现电视AIPQ的厂商,而这自然是因为他们自己有片源

一方面,正如手机厂商在设计“AI影像”算法时,首先需要先让摄影师拿着相机拍个几万张、几十万张照片,给手机里的“AI模型”充当训练教材一样。当电视厂商、电视芯片厂商在设计AI图像处理算法时,显然也需要有大量的影视资源来作为AI的“训练来源”,通过让AI分析“高品质画面应该是什么样的”,才能让它(算法)知道,应该把低清晰度、色彩不佳的视频,处理成何种程度为佳。

于是这里就必然存在着一个很尴尬的问题,NVIDIA当然拥有自己的超算去训练这些AI图像处理算法,但他们却未必拥有足够的影视资源版权去给AI充当“训练材料”。当然,要说老黄是买不起影视版权吗?显然不至于。但问题是,他确实没有必要为了这么个很小的功能去花大价钱。

另一方面,对于如今的智能电视来说,它们不只是一种“视频播放设备”,同时往往也集成了播控平台。这也就意味着,尽管电视里强大的AIPQ算法,确实可以将“低清”画面处理为高清的、色彩鲜艳的、细节丰富的效果,但播控平台也完全可以用“不付费就压根不给看”的方式,让用户必须乖乖掏钱。

但电脑就不是这种情况了,要知道电脑上的版权可就太“自由”了。对于电脑用户来说,视频平台可没办法控制他们不从其他的渠道、从其他网站找到能正常播放的资源。在这个前提下,如果NVIDIA还将“RTX视频超分”做得特别完善,让盗版视频看起来都能与正版的超清效果一模一样的话,大家觉得这难道不会出什么问题吗?

【本文图片来自网络】

本文来自微信公众号 “三易生活”(ID:IT-3eLife),作者:三易菌。